Lo scorso 29 settembre, dopo anni in cui veniva criticato per non fare abbastanza contro il proliferare di disinformazione a tema sanitario sulla sua piattaforma, YouTube ha finalmente modificato le sue policy per applicare il pugno di ferro sul tema e rimuovere tutta la disinformazione legata ai vaccini dal sito. Ha anche annunciato l’intenzione di bannare alcuni degli influencer che il Center for Countering Digital Hate ha identificato come quelli che più diffondono disinformazione sull’argomento.

Ma nonostante l’introduzione di queste nuove regole, la piattaforma sembra fare ancora molta fatica a contrastare la disinformazione e specialmente i contenuti no-vax. Secondo un’indagine di Media Matters, dall’annuncio del “pugno di ferro” ad oggi, YouTube ha continuato a ospitare almeno 50 video no-vax che hanno ottenuto in totale quasi 5 milioni di visualizzazioni; l’indagine ha anche scoperto che alcuni di questi video avevano pubblicità, il che vuol dire che YouTube li stava monetizzando.

Secondo l’indagine, molti dei video ancora presenti sulla piattaforma erano video degli influencer già bannati ricaricati su altri account, che permettevano così loro di continuare a fare propaganda antivaccinista. Per esempio un video della youtuber Mikhaila Peterson, la figlia dell’intellettuale Jordan Peterson, contiene un’intervista con Mercola, un osteopata che il New York Times ha definito un “pioniere del movimento antivaccinista”. Quel video è ancora presente sulla piattaforma e ha oltre 700mila visualizzazioni. Media Matters ha anche trovato su YouTube video in cui compare l’influencer no-vax Robert F. Kennedy, che in teoria sarebbe stato bannato da YouTube.

Da tempo YouTube riceve critiche perché non riesce ad arginare la disinformazione che prolifera sui suoi canali e che viene diffusa ulteriormente dagli algoritmi che consigliano i video agli utenti. In particolare, secontro i critici il feed algoritmico di YouTube promuoverebbe contenuti sempre più estremi e sensazionalistici sulla base degli interessi degli utenti. In teoria YouTube avrebbe implementato delle modifiche al proprio algoritmo per combattere questo fatto, e nega che l’algoritmo contribuisca a radicalizzare gli utenti.

Il mese scorso, dopo tutte queste critiche che riguardano la sua incapacità di arginare il ruolo che la piattaforma gioca nella diffusione delle teorie del complotto, YouTube ha annunciato che avrebbe rimosso i contenuti che “affermano falsamente che i vaccini siano pericolosi e causino danni cronicci per la salute, o che affermano che i vacccini non riducano la trasmissione delle malattie, e che diffondono notizie false sulle sostanze contenute nei vaccini”. Ma se l’inchiesta di Media Matters ci dice qualcosa, ci dice che gli sforzi di YouTube non sono abbastanza.

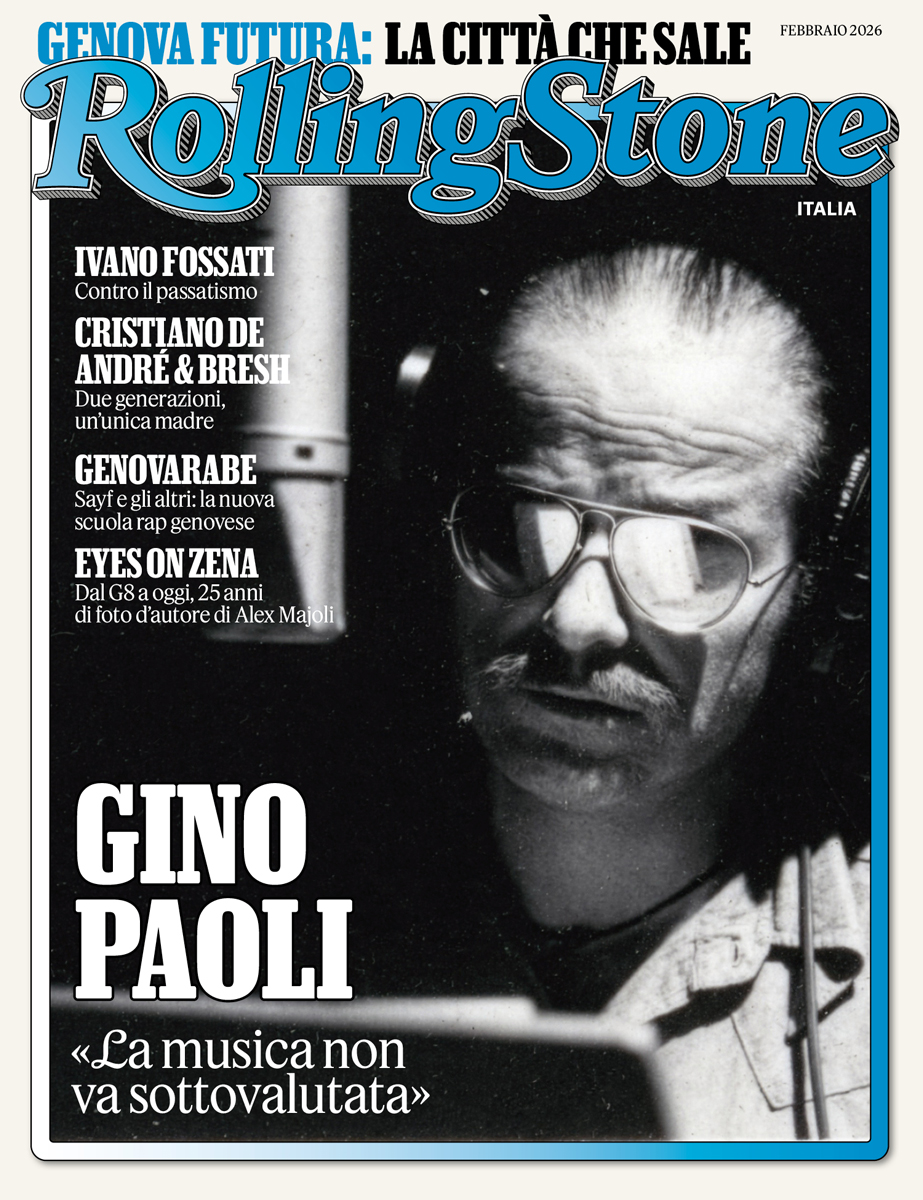

Questo articolo è apparso originariamente su Rolling Stone US