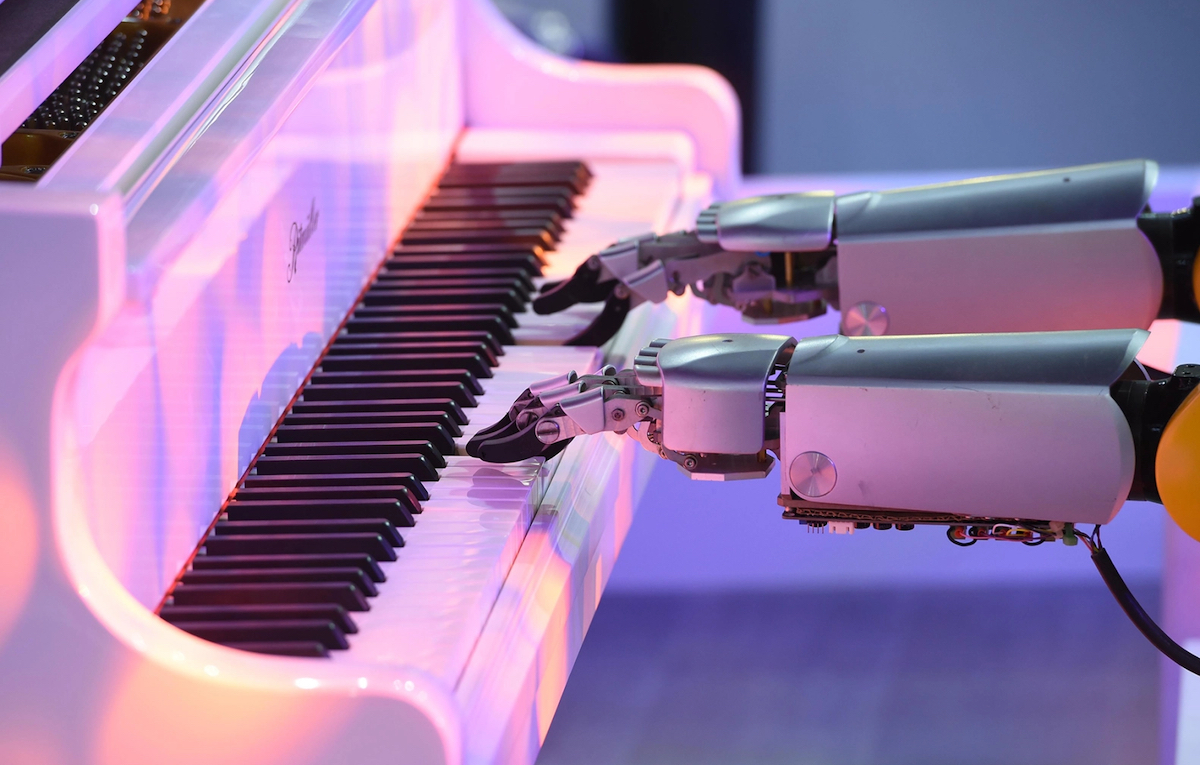

Google ha lanciato uno dei più attesi generatori di musica basati sull’intelligenza artificiale, uno strumento potente che permette all’utente di descrivere la musica che desidera ascoltare. In base a questa descrizione, il sistema genera un brano nel giro di pochi secondi. Rappresenta potenzialmente una svolta nel settore in fermento dell’AI applicata alla musica. Almeno per ora, però, la musica prodotta non è un granché.

Il sistema si chiama MusicLM, Google l’ha presentato in un report a gennaio, sorprendendo il mondo della musica e quello tech con esempi di brani generati dal software partendo da testi scritti (analogamente a quanto fanno ChatGPT oppure DALL-E e Midjourney per le immagini). Quattro mesi fa, Google dichiarava di non avere intenzione di distribuire immediatamente MusicLM per via di potenziali complicazioni come quelle legate alla violazione dei diritti d’autore. Mercoledì scorso l’azienda ha lanciato il software, aprendo una lista d’attesa per ottenere l’accesso. Per ovviare al problema del copyright, MusicLM non genera musica nei casi in cui si chieda di creare canzoni a partire dalle caratteristiche di un artista esistente.

MusicLM chiede di essere molto descrittivi nelle richieste, dettagliando tutto, dal genere agli strumenti da usare fino all’atmosfera e alle sensazioni da trasmettere, come «musica tradizionale giapponese per flauto triste e malinconica». Al suo meglio, MusicLM è sorprendente e crea brani azzeccati, come quando abbiamo chiesto «un ritmo hip hop funky e allegro con fiati» o un «motivetto elettronico da sala giochi». L’output ad altre richieste come quella di un quartetto d’archi classico che suonasse una musica romantica per percorrere la navata della chiesa a un matrimonio oppure una musica natalizia allegra con le campane non è stato altrettanto soddisfacente. I suoni sono a volte sporchi e di bassa qualità, a volte decenti, raramente buoni.

È comunque un esperimento promettente. MusicLM è ancora in versione demo, la tecnologia che lo supporta è destinata a migliorare, è normale che presenti imperfezioni. Il suo lancio è solo l’ultimo episodio, in ordine di tempo, in un anno di svolta per il rapporto tra intelligenza artificiale e musica. I creatori di musica basati sull’AI come Soundful e Boomy sono in grado di costruire melodie o basi musicali con un click. Negli ultimi mesi sono diventati virali brani che utilizzano cloni vocali di superstar come Drake e Kanye West, impressionando per la capacità dell’AI di imitare le voci degli artisti in carne e ossa. I risultati hanno messo in allarme l’industria musicale, che in questa tecnologia vede sì un notevole potenziale come strumento utile nella creazione di musica, ma è preoccupata dal rischio di incasinare ulteriormente il mondo già torbido del copyright musicale.

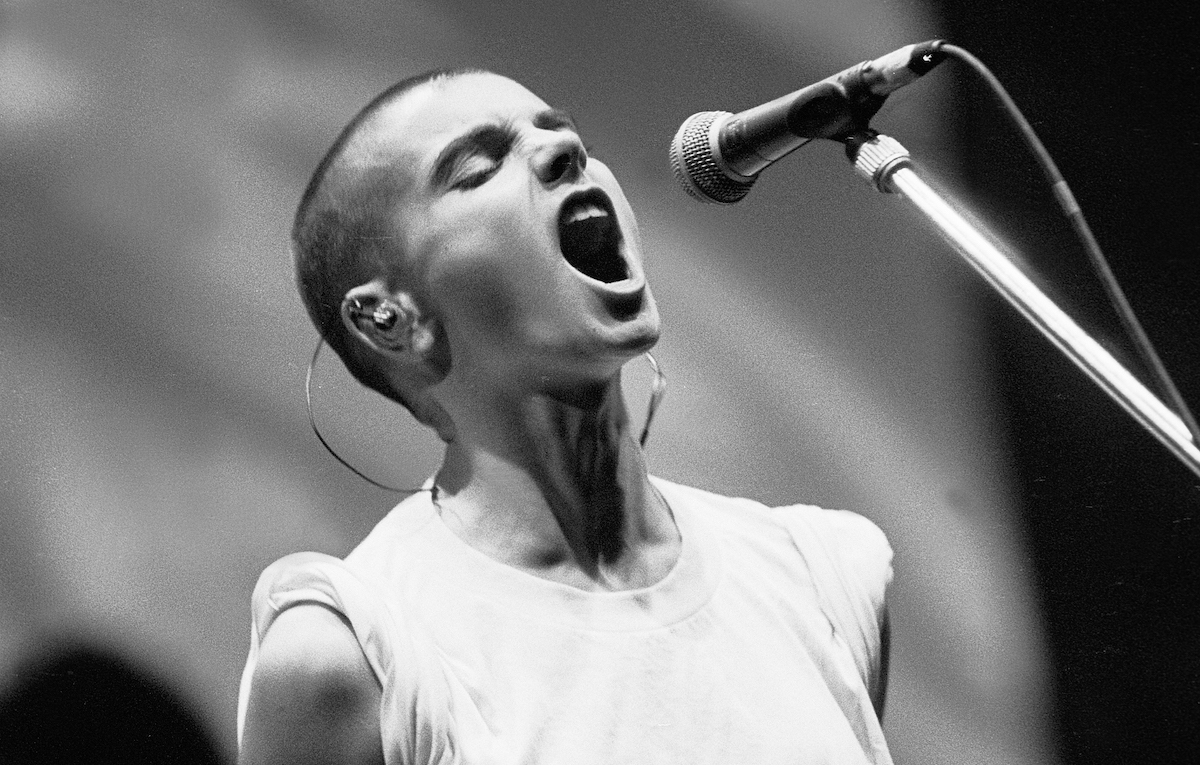

Heart On My Sleeve, la canzone con le voci di Drake e The Weeknd generate dall’intelligenza artificiale, è diventata subito virale ed è stata ritirata dalle piattaforme dopo pochi giorni. Pezzi come questo sollevano questioni legali spinose su ciò che è lecito e illecito. Universal Music Group, che gestisce la musica di entrambi gli artisti, ha chiesto a gran voce alle aziende musicali partner di porre un limite alla musica creata con l’AI quando questa viola i diritti d’autore degli artisti.

«Il training dell’intelligenza artificiale fatto usando la musica dei nostri artisti (che rappresenta sia una violazione dei nostri accordi che della legge sul copyright) e la presenza nei servizi di streaming di contenuti contraffatti creati con l’AI sollevano domande sulle parte della storia in cui si vuol stare: da quella degli artisti, dei fan e dell’espressione creativa umana oppure dalla parte dei deep fake, delle frodi e della negazione del giusto compenso dovuto agli artisti», si legge in un comunicato di Universal. «Questi casi dimostrano come le piattaforme abbiano la precisa responsabilità legale ed etica di impedire l’utilizzo dei loro servizi in un modo che danneggia gli artisti».

A marzo, molte delle maggiori istituzioni e gruppi commerciali del settore musicale hanno dato vita alla Human Artistry Coalition con lo scopo di proteggere gli artisti e garantire che lo sviluppo dell’AI favorisca gli artisti al posto di cercare di sostituirli.

«L’AI ha un potenziale enorme, ma presenta dei rischi per la nostra comunità creativa», ha dichiarato Harvey Mason Jr, CEO della Recording Academy in un comunicato diffuso in occasione della costituzione della Coalition. «È fondamentale agire in fretta per non rischiare di perdere la magia che solo artisti in carne ed ossa possono creare».

Da Rolling Stone US.